Viime lauantaina 25. päivänä sosiaalisessa mediassa levisi kuva paavista valkoisella takkilla tai pikemminkin takilla.

Internetissä kohua aiheuttaneesta kuvasta huolimatta kuva on väärennös ja tekoälyn tekemä. Tässä artikkelissa selitämme paremmin paavin valokuvan Tekoäly.

Katso lisää

Nämä ovat 4 horoskooppimerkkiä, jotka rakastavat yksinäisyyttä eniten…

Jotkut koirarodut ovat täydellisiä ihmisille…

Paavin kuva on tehty tekoälyllä

Jos käytit sosiaalista mediaa 25. maaliskuuta, törmäsit todennäköisesti jossain vaiheessa kuvaan paavista pukeutuneena takkiin.

Kuva aiheutti valtavan kohun sosiaalisissa verkostoissa, kun monet Internetin käyttäjät alkoivat ylistää paavi Franciscuksen oletettua nykyaikaisuutta ja tyyliä.

Totuus on kuitenkin, että kuva oli väärennös ja tekoälyn rakentama.

Kuva ei ollut ainoa tekoälyn ansiosta viime päivinä levitetty väärä tieto, loppujen lopuksi meillä oli myös vääriä tietoja Yhdysvaltain entisen presidentin Donald Trumpin väitetystä pidätyksestä. Valtti.

Näiden kuvien rakentamiseen käytettyä tekoälyä kutsutaan generatiiviseksi tekoälyksi, joka loppujen lopuksi pystyy tuottamaan uutta koko ajan.

Näiden paljastuneiden väärien tietojen tapauksessa luotu sisältö oli kuvia. Toinen esimerkki generatiivisesta tekoälystä on kuitenkin ChatGPT, joka pystyy luomaan uutta sisältöä tekstien avulla.

Generatiivinen tekoäly

Tekoälyjä on erilaisia ja alan päänimet ovat Dall-e (samalta luojalta kuin GPT), Stable Diffusion ja Midjourney. Esimerkiksi paavin kuvan loi Midjourney, joka julkaisi kuvan virallisella Reddit-profiilillaan.

Midjourney lupaa päivityksiä entistä realistisemmilla tuloksilla ja uuden kuvan luominen on hyvin yksinkertaista, kuvaile vain kuvaa, jonka haluat luoda, esimerkiksi: "Siamilainen kissa makaa valkoisella sohvalla tyyliin renessanssi".

Kuva on rakennettu realistisesti "generatiivisen vastustavan verkoston" ansiosta, joka on vain tekoälyn oppimismalli.

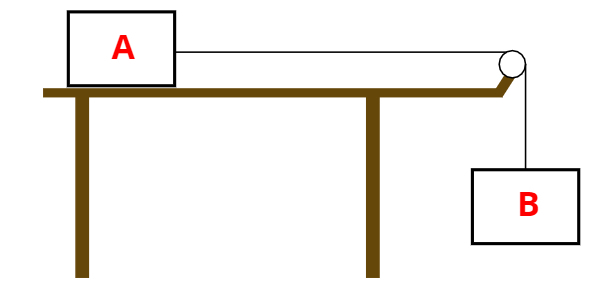

Se toimii toisen tekoälyn kanssa, joka arvioi luotua sisältöä, aivan kuin yksi kone sanoisi toiselle "ei ollut hyvä, tee se uudelleen", kunnes se saavuttaa tyydyttävän tuloksen.

Näiden kuvien vaara

Vaikka on mahdollista tunnistaa, että kuva on tekoäly, joidenkin virheiden ansiosta, jotka kone jättää huomiotta huomaamatta, kuten vääristyneet kädet paavin valokuvassa, kuva välittää paljon uskottavuutta, koska monet ihmiset jättävät sen huomiotta myös huomaamatta.

Tällä tavalla näistä kuvista tulee vaara, että niistä tulee mahdollinen syvän väärennösten leviämisen lähde.

Sitä vastoin DARPA (US Defence Advanced Research Projects Agency) on aloittanut työskentelyn teknologian parissa, jonka avulla voidaan tunnistaa väärennettyjä kuvia ja torjua syvän väärennösten leviämistä.